Guten Morgen! Immer wenn wir den Newsletter fertig geschrieben haben, veröffentlicht OpenAI am späten Abend noch ein großes Update. Machen die das absichtlich? Jedenfalls gibt es jetzt die “Canvas”-Funktionen. Ein paar nette Tricks, die die Arbeit mit ChatGPT schneller machen. Es wird immer deutlicher, dass wir uns von der Chatbot-Oberfläche wegbewegen. Jetzt aber rein in die wichtigsten KI News!

Peanuts für heute:

🤖 OpenAI DevDay: AGI-Level 2 und der Rest..

🎬 Schweizer Forscher machen Googles reCAPTCHAv2 System unbrauchbar

🛠 Unser neues Lieblingstool: Notebooklm

🥜 Die größte Nuss:

🤖 OpenAI DevDay: AGI-Level 2 und der Rest..

OpenAI hatte am Dienstagabend zum DevDay nach San Francisco geladen. Anders als letztes Jahr gab es diesmal keinen Livestream. Warum? Keine Ahnung. Viele vermuten, dass es einfach nicht viel Neues zu berichten gab. Trotzdem betrat Sam Altman, dem die stressigen letzten Wochen sicher ins Gesicht geschrieben standen, die Bühne und behauptete, OpenAI habe 'AGI Level 2' erreicht.

Kurz zur Einordnung: AGI steht für "Artificial General Intelligence" – der heilige Gral der KI, wenn man so will. Weil der Begriff recht vage ist, hat OpenAI letztes Jahr ein 5-Level-System eingeführt. Level 1 war der Durchbruch bei Chatbots, den OpenAI schon 2022 erreicht hat. Level 2 bedeutet, dass Maschinen Probleme auf einem menschlichen Niveau lösen können – und Altman ist überzeugt, dass ChatGPT das jetzt kann. Der nächste Schritt? Level 3: KI-Agenten, die eigenständig Aufgaben übernehmen. Und laut Altman sollen diese Agenten bis 2025 bereit sein, Aufgaben in wenigen Stunden zu erledigen, für die Menschen früher Tage oder Wochen gebraucht haben.

Okay, solche Versprechen kennen wir inzwischen aus dem Silicon Valley. Davon lassen wir uns nicht beirren! Kommen wir also zu den Sachen, die heute schon verfügbar sind.

Echtzeit-API für Sprachmodelle: Die “advanced voice mode” Funktion von ChapGPT, die uns alle an den Film Her erinnert hat (und auf die wir Europäer immer noch warten müssen), wurde nun für Entwickler freigegeben. Entwickler mussten bisher verschiedene Modelle zusammenbasteln, um sprachgesteuerte Anwendungen zu bauen. Mit der neuen Echtzeit-API geht das jetzt mit einem einzigen API-Aufruf.

Hauptanwendungsbereiche sind der Kundensupport, wo die Antworten noch menschlicher und fließender werden sollen, und Sprachlern-Apps, die immersivere, interaktive Szenarien bieten.

Ein interessanter Punkt: Die Kosten für eine Stunde Gespräch liegen bei 18$, und wären damit deutlich teurer als die Stundenlöhne vieler ausländischer Callcenter. Seitdem wir diesen Newsletter schreiben sind allerdings die Kosten für ChatGPT Tokens um 90% gesunken. Das Gleiche wird hier auch passieren.

Vision Fine-Tuning API: Damit können Entwickler GPT-4 für Bild- und Textaufgaben anpassen und verbessern. Bisher war das Fine-Tuning auf Text beschränkt, aber jetzt kann die KI Text- und Bilddaten kombinieren. Das eröffnet neue Möglichkeiten: von der präziseren Analyse medizinischer Bilder bis zur Objekterkennung für autonome Fahrzeuge oder verbesserten visuellen Suchfunktionen. Nice!

Modelldestillation: Diese neue Funktion erlaubt es Entwicklern, kleinere und kostengünstigere Modelle zu erstellen, ohne bei der Leistung Abstriche machen zu müssen. Besonders wichtig wird das, wenn man Modelle lokal auf kleineren Geräten laufen lassen will.

Alles in allem gab es also keine riesigen Ankündigungen wie im letzten Jahr – kein GPT-5, nicht mal Superintelligenz 😉.

Stattdessen präsentierte OpenAI technische Zwischenschritte, die darauf abzielen, KI noch stärker in unseren Alltag zu integrieren, und zwar über eine Vielzahl von Geräten und Schnittstellen. Auch wenn OpenAI derzeit ein stückweit durch eine Krise zieht, sehen wir hier weiterhin die Speerspitze der KI-Entwicklung und hunderte Arbeiter, Gründerinnen und StartUps bangen um ihre Existenz. Für diesen Dev-Day können sie erstmal aufatmen..

🛠 Trai it out:

NotebookLM: Ja, wir hatten dieses Tool vor 2 Wochen schon mal vorgestellt. Aber es beeindruckt uns so sehr, dass wir es noch mal umfangreicher vorstellen wollen:

Aus jeder Textdatei, jedem Chatlog, YouTube-Link, PDF oder Artikellink einen Podcast generieren, der die Inhalte meisterhaft zusammenfasst!

NotebookLM ist kostenlos und soll bei der Recherche helfen. Der Clou ist das große Kontextfenster, das das Gemini-Modell bietet. Man kann mit großen Mengen an Text arbeiten und dann z.B. automatisch eine Unterhaltung mit zwei Stimmen generieren, die sich über den Inhalt unterhält. Wenn man den Link zu einem Wikipedia-Artikel als Quelle einfügt, erhält man einen Podcast zu dem Inhalt. Es fühlt sich wie Magie an. Unbedingt ausprobieren!

Unser Tipp: Geht in eine WhatsApp-Unterhaltung (auch Gruppen) und exportiert den Chat (Direkt in den Chateinstellungen). Zieht die Text-Datei als Quelle in NotebookLM und lasst euch die Audio-Zusammenfassung generieren. Was dabei herauskommt, ist eine Abhandlung über die Dynamiken der Menschen in der Unterhaltung, erzählt Highlights und Insider-Jokes. Man lernt sogar richtig etwas dazu.

Weitere Neue Tools, Updates & Demos:

Byword — Erstelle hochwertige, KI-generierte Artikel in großem Umfang. Auch auf Deutsch!

Creatify - Der schnellste Weg, Videoanzeigen zu erstellen.

Inbox Zero- Automatisiere deine E-Mails mit KI, melde dich in großen Mengen von Newslettern ab und blockiere unerwünschte E-Mails. Open-Source.

🍭🍬 Gemischte Tüte

🇪🇺 EU-News:

👩💻 Tech-News:

OpenAI hat erfolgreich eine neue Finanzierungsrunde abgeschlossen und 6,6 Milliarden Dollar aufgebracht – der größte VC-Deal aller Zeiten – mit einer Bewertung von 157 Milliarden Dollar. Link

Schweizer Forscher haben gezeigt, dass KI Googles Bot-Erkennungssystem besiegen kann. Die Gruppe der ETH Zürich nutzte maschinelles Lernen, um 100% von Googles reCAPTCHAv2 zu lösen, das Menschen von Bots unterscheiden soll. Link

Amazon hat still und leise einen neuen KI-Chatbot eingeführt, der sicherer als ChatGPT sein soll und von den Mitarbeitern genutzt wird. Link

Microsofts riesige Wette auf KI soll zu Datenzentrums-Mietverträgen im Wert von über 100 Milliarden Dollar führen. Link

Anthropic stellt OpenAI-Mitgründer Durk Kingma ein. Link

Meta verrät nicht, ob KI mit Fotos von den Smart Glasses trainiert wird. Was doch eigentlich nur heißen kann, dass die genau das tun. Link

Bevor Mira Murati überraschend OpenAI verließ, murrten Mitarbeiter, dass das o1-Modell zu früh veröffentlicht wurde. Link

Und Alphabet arbeitet Berichten zufolge an einem eigenen reasoning-fokussierten Modell, um OpenAIs o1 zu konkurrieren, und könnte sich mit Samsung bei der Entwicklung von KI-gestützten Smartglasses zusammenschließen. Link

Nvidia hat ein neues, offenes und massives KI-Modell veröffentlicht, das GPT-4 Konkurrenz machen soll. Wir fragen uns: Warum will man mit seinen größten Kunden in direkte Konkurrenz gehen? Link

Alle Neuigkeiten zu den neuesten Copilot- und Windows-KI-Funktionen von Microsoft. Link

Der KI-Chiphersteller Cerebras hat den Börsengang beantragt, um gegen Nvidia anzutreten. Link

ByteDance trainiert Berichten zufolge ein neues KI-Modell auf Huawei-Chips statt auf Nvidia-Chips. Wird spannend, ob und wie China sich von Nvidias Abhängigkeit lösen kann, seitdem es Exportbeschränkungen gibt. Link

Elon Musk zieht mit xAI in OpenAIs alte Zentrale – wahrscheinlich aus Trotz?Link

Meta hat den Digital Twin Catalog (DTC) gestartet, der über 2.400 realistische 3D-Modelle mit submillimetergenauer Genauigkeit enthält. Link

👷 Work:

Essay: “Ich habe das Unterrichten wegen ChatGPT aufgegeben”. Link

🔐 Cybersecurity:

Das ist so ironisch... Ein Unternehmen namens DoNotPay muss 193.000 Dollar Strafe zahlen, weil es fälschlicherweise einen nicht getesteten KI-Anwalt beworben hat, sagt die FTC. Link

🏥 Health:

Das Biotech-KI-Startup Recursion hat die FDA-Zulassung erhalten, um mit der Prüfung eines Krebsmedikaments zu beginnen, das mit seiner KI-Plattform entdeckt wurde. Link

🖼️ Kreativindustrie:

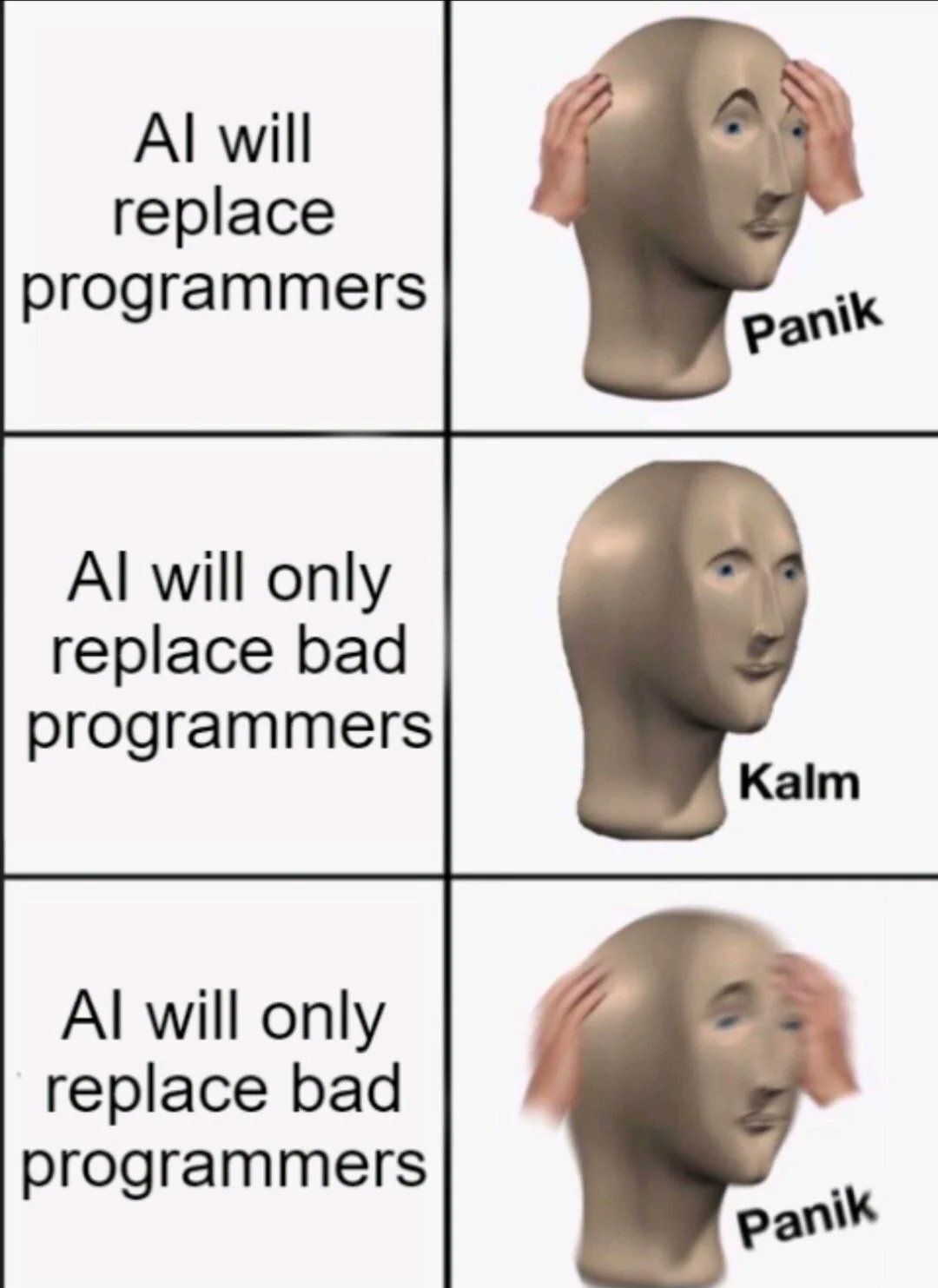

🔥 Takes:

🧂 Salty Memes:

Wir wollen uns verbessern! Wie hat dir diese Ausgabe gefallen? Welche Themen wünschst du dir für die Zukunft mehr?

Bis Freitag!