Hallo Freunde - wir hoffen ihr hattet einen sonnigen Start in eure Woche! ☀️

Peanuts für heute:

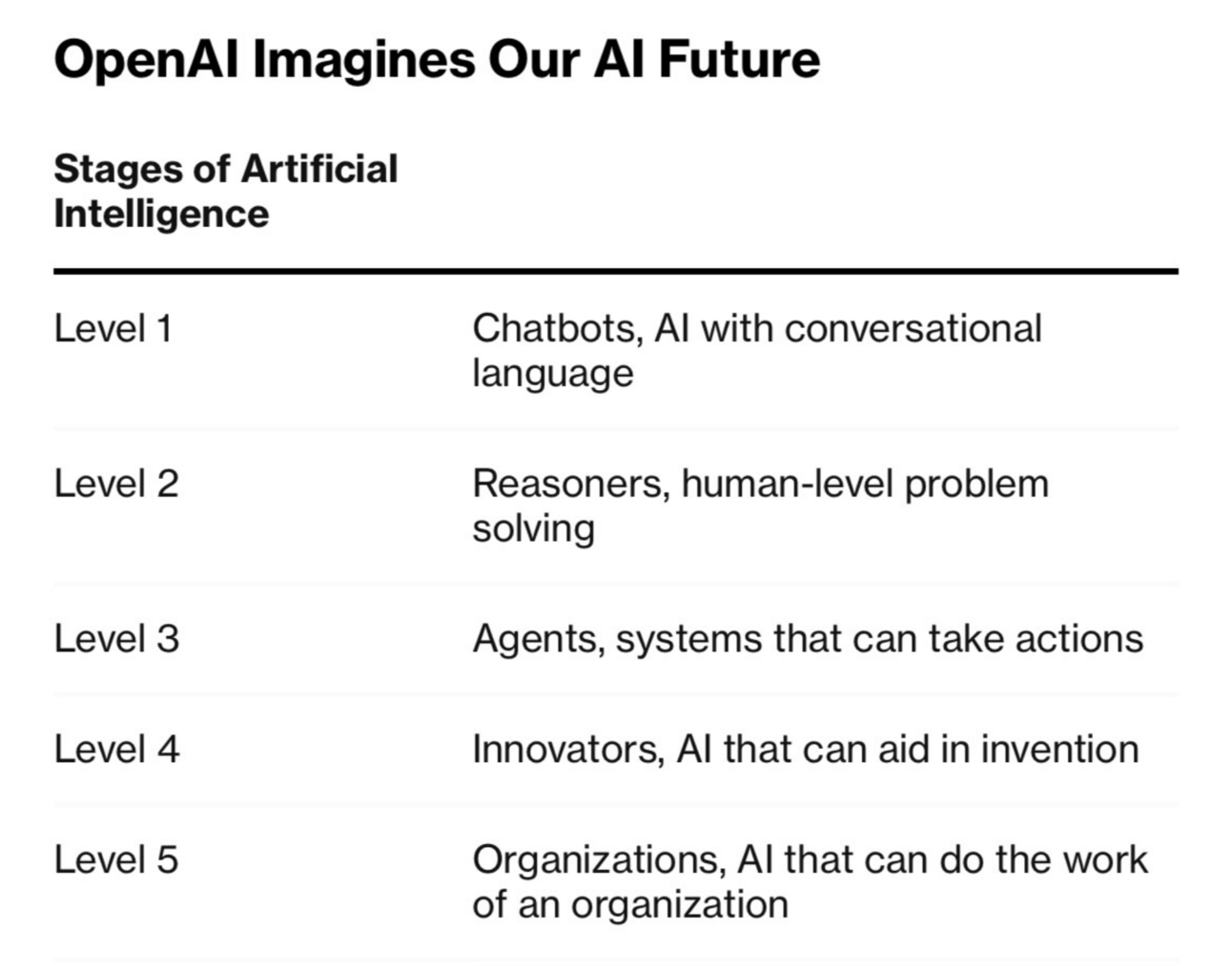

🖖 OpenAI: die 5 Level bis AGI

🥊 GPT-4 vs. Verschwörungstheorien

🛠 Listenly und Eleven Labs Reader machen aus Texten Audiobücher

🥜 Die größte Nuss:

🖖 OpenAI: die 5 Level bis AGI

Eine Weile haben wir nichts Großes mehr über OpenAI geschrieben. Vielleicht blicken wir alle in fünf bis zehn Jahren auf OpenAI zurück und stellen fest, dass es wie Yahoo im DotCom-Boom war: ein früher Champion einer neuen Technologiewelle, aber kein neues Big-Tech-Unternehmen in seinen Anfängen. Doch noch führen alle KI-Wege ins Silicon Valley, ins OpenAI-Hauptquartier. Und es gibt ein paar neue Entwicklungen zu berichten:

Der innere Konflikt bei OpenAI noch immer nicht gelöst. In den letzten Tagen haben sich neue Whistleblower an die Medien gewandt und berichtet, dass OpenAI sie mit juristischen Mitteln gezwungen habe, Sicherheitsbedenken nicht öffentlich zu machen. Das ist definitiv schlecht gelöst und hat offensichtlich nicht funktioniert. Aus unternehmerischer Sicht ist es jedoch etwas nachvollziehbar. Die aktuelle Richtlinie zur Regulierung von Sprachmodellen, über die derzeit in Kalifornien entschieden wird, beinhaltet viele der Forderungen von KI-Doomern, die OpenAI zu verhindern versucht. Ob die Doomer recht haben, ist schwer zu sagen. Das Vorgehen der Regulierer hingegen ist gelinde gesagt fragwürdig. Andrew Ng, einer der Pioniere des maschinellen Lernens, hat sich in einem Blog-Beitrag zu den kalifornischen Regulierungsmaßnahmen geäußert und diese eindrucksvoll erklärt. Zusammengefasst und in den Worten von Ben Evans: “Probleme der generativen KI durch die Regulierung der Modelle zu lösen, ist so, als würde man versuchen, Finanzbetrug durch die Regulierung von Spreadsheets zu verhindern.”

Man kann also zumindest nachvollziehen, warum OpenAI alles tun wollte, um zu verhindern, dass Mitarbeiter solche Regulierungsbeschlüsse befeuern. Das soll diese Schritte nicht rechtfertigen, und schiefgelaufen ist es trotzdem.

Aber wohin soll die Reise gehen? Auch dazu gibt es jetzt mehr Informationen. Auf dem Weg zum selbsternannten AGI-Ziel, also der Entwicklung einer allgemeinen künstlichen Intelligenz, gibt es nun ein Fünf-Level-System, das den Fortschritt messen soll. Derzeit befindet sich OpenAI laut eigenen Angaben auf Level 1, bei dem Chatbots sich flüssig mit Nutzern unterhalten können. Das zweite Level ist das Reasoning: Hier geht es darum, dass die KI-Modelle logische Schlussfolgerungen auf menschlichem Niveau ziehen können. Dieser Schritt ist schon unheimlich groß, aber OpenAI arbeitet bereits daran. Unter dem Codenamen ‘Strawberry’ entwickelt OpenAI eine neue Technologie, die logische Zusammenhänge erschließen und Schlussfolgerungen ziehen soll. Von Level 3, bei den Agenten, also Systeme, die selbst Aktionen durchführen können, sind wir noch weit entfernt. Danach folgt Level 4, bei dem KI ‘Innovationen’ herbeiführen oder unterstützen kann, und schließlich Level 5, bei dem KI-Systeme die Aufgaben ganzer Organisationen ausführen sollen.

Natürlich überschneiden sich diese Level stark, und es gibt tausende Unter-, Über- und Zwischenprobleme. Aber ein leicht verständliches Framework für die Zukunft von OpenAI ist dennoch wahnsinnig hilfreich. Ob dieses Level-System in wenigen Jahren noch Relevanz findet, werden wir dann herausfinden. Wir sind auch nicht zum Schweigen verpflichtet – versprochen!

🛠 Trai it out:

Heute gibt’s Featured Tools im Doppelpack, denn beide sind sehr ähnlich:

Listenly — Dieses Tool verwandelt Texte in ganze Audiobücher. Eine handvoll Bücher und Texte, wie z.B. die beliebten Essays von Paul Graham, gibt es umsonst. Weitere lassen sich einzeln kaufen, z.B. 70.000 Bücher aus der Public Domain, die als Text frei verfügbar sind.

Eleven Labs Reader (iOS) — Macht quasi das selbe: Wandelt Text in Audio um und ermöglicht es so z.B. die aktuellsten Nachrichten zu hören, statt zu lesen. Die Qualität ist nicht mehr von einem menschlichen Sprecher zu unterscheiden. Aktuell für 3 Monate gratis, allerdings noch nur auf Englisch. Weitere Sprachen und eine Android App folgen aber wohl in Kürze!

Weitere Neue Tools, Updates & Demos:

Storm — An der Uni Stanford entwickelt. Dieses Tool recherchiert für euch und schreibt einen Wikipedia-artigen Artikel zu jedem beliebigen Thema

LivePortrait — Animiert Fotos mit realistischer Mimik

AI Web Designer — Erstellt im Handumdrehen Vorschläge für’s Redesign eurer Website

Dropbase — Open Source KI-gestützter Web App Builder

Telescope — Diese KI hilft beim Finden von neuen Sales-Outbound Kontakten

Text-to-CAD — Dieses KI-Modell erzeugt 3D-CAD Modelle aus einem Prompt

MarketGeniusAI — Macht Aktien-Infos mit KI interaktiv analysierbar

🍭🍬 Gemischte Tüte

🇪🇺 EU-News:

Eine deutsche Studie sagt, dass KI im öffentlichen Dienst 165.000 Vollzeitkräfte ersetzen könnte. „Unterstützen“ wäre eine bessere Formulierung gewesen, aber nun gut. Link

👩💻 Tech-News:

Kleiner Datapoint, wie schwer es ist, KI-Chips skalierbar herzustellen. Graphcore versuchte, KI-Chips zu produzieren (noch vor der aktuellen LLM-Welle), aber Hardware is hard, und jetzt wurde es von Softbank für wenig Geld aufgekauft. Link

Eines der Kernargumente rund um generative KI ist, wie „clever“ die Modelle wirklich sind, im Gegensatz dazu, wie clever sie erscheinen – verstehen sie, oder imitieren sie das Verständnis? Hier schlägt eine Studie vor, dass ChatGPT bei Coding-Problemen, die wahrscheinlich in den Trainingsdaten enthalten sind, viel besser ist (was Letzteres nahelegt). Link

Coatues jährliche Präsentation zum Stand der Venture-Tech-Investitionen, insbesondere im Bereich KI. Link

Wir hatten letzte Woche davon berichtet. Ein 3-Milliarden-Dollar-Software-Unicorn hat seinen Plan, KI „Arbeiterrechte“ zu geben, wieder verworfen, nachdem Tech-Manager sagten, es „missachte die Menschlichkeit deiner echten Mitarbeiter“. Link

Die NATO hat ihre überarbeitete Strategie für künstliche Intelligenz (KI) veröffentlicht, die darauf abzielt, den Einsatz von KI-Technologien innerhalb der NATO sicher und verantwortungsvoll zu beschleunigen. Link

Funktioniert Role-Prompting bei neuen LLMs gar nicht mehr? Wird von einigen behauptet. Es gibt allerdings auch Gegenmeinungen. Link

Patronus AI hat die Veröffentlichung von Lynx angekündigt. Dieses hochmoderne Halluzinationserkennungsmodell verspricht, bestehende Lösungen wie GPT-4, Claude-3-Sonnet und andere Modelle zu übertreffen, die in geschlossenen und Open-Source-Umgebungen als eine Art Richter fungieren. Link

Wie Apple Intelligence die Nutzung von Siri auf deinem iPhone verändern könnte. Link

Ärzte in den USA nutzen jetzt LLMs, um mit Versicherern zu streiten. Das ist ziemlich genau der Witz vom letzten Jahr, dass die Hälfte der LLMs drei Stichpunkte in drei Absätze verwandeln und die andere Hälfte drei Absätze in drei Aufzählungspunkte zusammenfassen wird. Link

A16Z hat in Hebbia investiert, dessen Produkt LLM-basierte Agenten für Finanzanalysen ermöglicht. Link

👷 Work:

🆕 Neue Anwendungsfelder:

Am Strand von Rimini wird jetzt KI genutzt, um vermisste Kinder zu finden. Link

Wissenschaftler haben untersucht, ob eine Unterhaltung mit GPT-4 zum Umdenken bei Verschwörungstheorien führen kann. Und tatsächlich - bis zu einem gewissen Grad ist das möglich. Link

Dieses Paper von Microsoft beschreibt eine Methode, mit der LLMs zukünftig Excel-Spreadsheets besser verstehen können. Link

🔐 Cybersecurity:

Ein Profil eines der Unternehmer, die generative KI nutzen, um Spam-Websites im großen Stil zu erstellen. Link

🏥 Health:

KI übertrifft klinische Tests bei der Vorhersage von Alzheimer. Als jemand, der Menschen mit Alzheimer in der Familie hat, kann ich nur sagen: ENDLICH! Diese Tests sind schrecklich. Link

🖼️ Kreativindustrie:

🧂 Salty Memes:

Wir wollen uns verbessern! Wie hat dir diese Ausgabe gefallen? Welche Themen wünschst du dir für die Zukunft mehr?

Bis Freitag!